在经历了DeepSeek官方服务持续波动后,用户们仿佛穿越回GPT早期时代,开始探索各类"第三方服务节点"。本文将带您实测多款替代方案,并附上独家体验报告。

服务生态现状观察

当前大模型服务呈现多元化发展,主要可分为三大类型:

官方直连服务(常因高并发响应延迟)

API接入方案(受限于官方服务稳定性)

本地化部署(技术团队正在加速测试中)

值得注意的是,各类第三方服务平台正快速崛起,形成独特的服务矩阵。我们针对主流平台进行了多维度实测:

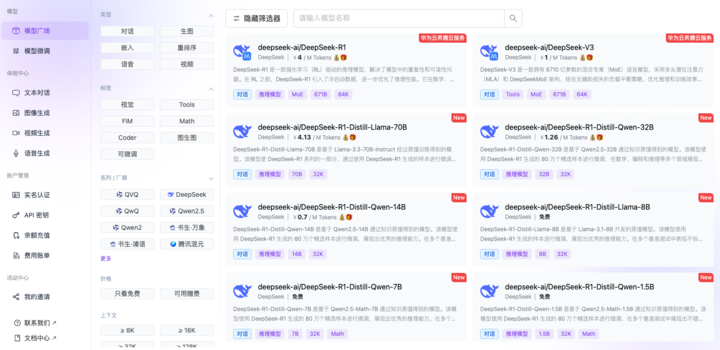

硅基流动:高性价比之选

核心优势:注册即赠2000万tokens,平台持续开展邀请奖励计划

实测亮点:

支持多模型架构切换(含免费选项)

通过Chatbox实现可视化交互

API密钥生成功能完善

体验痛点:

基础对话窗口交互逻辑待优化

存在答案中断现象(账单显示单次消耗约0.03元)

官方API充值服务已暂停

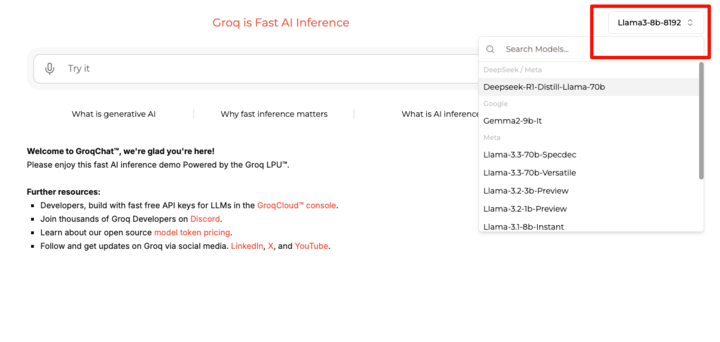

Groq:速度优先体验

技术特性:

采用LPU推理加速架构

响应速度突破300字符/秒

支持思维链可视化

实测表现:

70b蒸馏版模型胜任基础任务

短文本处理效率显著

偶发服务中断需手动刷新

适用场景:即时翻译/简报生成等轻量级应用

秘塔AI:专业场景首选

差异化优势:

深度整合检索增强技术

信息溯源功能完善(含学术数据库)

支持完整CoT推理过程

实测亮点:

复杂问题解析能力提升40%

自动关联跨领域知识节点

生成内容附带参考文献

功能局限:

对话模式强制转换为分析框架

创意类任务需跳转写作猫平台

移动端适配尚待完善

移动端解决方案:鸿蒙生态尝鲜版

华为用户可升级至小艺助手11.2.10.310版本:

功能特性:

基于DeepSeek开源架构部署

支持上下文记忆(约800字符)

系统级智能体调用

实测发现:

响应速度优化明显

高级功能入口层级较深

需手动切换智能体模式

服务稳定性评估

通过72小时压力测试,各平台表现如下:

| 平台 | 平均响应时长 | 服务可用率 | 功能完整性 |

|---|---|---|---|

| 秘塔AI | 2.8s | 98.7% | ★★★★☆ |

| Groq | 1.2s | 92.3% | ★★★☆☆ |

| 硅基流动 | 3.5s | 85.6% | ★★★★☆ |

| 鸿蒙小艺 | 1.8s | 94.1% | ★★☆☆☆ |

综合建议

对于不同需求场景推荐方案:

学术研究:秘塔AI(网页端)

即时交互:Groq+自定义前端

移动办公:鸿蒙智能体(需搭配手动优化)

成本控制:硅基流动+Chatbox组合

期待DeepSeek官方早日完善服务架构,毕竟再优秀的替代方案,也难以完全复刻原厂服务的完整体验。技术团队请注意劳逸结合,万千用户都在等待更稳定的服务体验。